Recherche

L’INSA Lyon accueille les JIM et la LAC 2025 : une immersion au cœur de l’informatique musicale

Du 23 au 28 juin 2025, l’INSA Lyon sera le théâtre d’un double événement exceptionnel : les Journées de l’Informatique Musicale (JIM) et la Linux Audio Conference (LAC). À la croisée des arts et des sciences, ces rencontres mêlant concerts, conférences et démonstrations techniques s’adressent aussi bien aux chercheurs qu’au grand public. Romain Michon, chercheur au CITI et coordinateur de l’événement, nous en dit plus.

Une double casquette pour un double événement

Romain Michon est chargé de recherche à l’INRIA et membre de l’équipe Émeraude au sein du laboratoire CITI de l’INSA Lyon. Il partage son temps entre recherche, enseignement et coordination scientifique. En 2025, il endosse également le rôle de General Chair des JIM et de la LAC. « Je pilote l’organisation des deux événements avec une équipe composée de collègues d’Émeraude, mais aussi d’autres institutions comme l’École Centrale de Lyon, l’Université Paris 8 Vincennes - Saint-Denis ou encore l’Université du Michigan », explique-t-il.

Organisées en partenariat avec l’INSA Lyon, l’INRIA et le GRAME (Générateur de Ressources et d’Activités Musicales Exploratoires - Centre national de création musicale), les deux conférences réuniront des experts du monde entier autour d’une même passion : l’informatique musicale.

Les JIM : un pont entre science et création artistique

Les Journées de l’Informatique Musicale (JIM), pilotées par l’Association française d’informatique musicale, se tiennent chaque année dans une ville différente. L’édition 2025 s’annonce riche et ambitieuse : « Les JIM sont un événement de trois jours mêlant présentations scientifiques et performances artistiques. On y retrouve des chercheurs, des musiciens, mais aussi des amateurs éclairés », détaille Romain Michon.

Deux concerts sont programmés les 23 et 24 juin au Théâtre Astrée à Lyon. Le lundi soir, un dôme sonore de 25 haut-parleurs plongera le public dans une expérience sonore en trois dimensions, « c’est un moment fort à ne pas manquer ! ».

Trois thématiques majeures et une ambition écologique

L’édition 2025 des JIM mettra en lumière trois grands axes : l’intelligence artificielle, les systèmes embarqués — spécialité de l’équipe Émeraude — et l’impact environnemental du numérique. « Comme dans beaucoup de domaines, l’informatique musicale s’interroge sur son empreinte écologique, notamment énergétique. Nous encourageons les travaux scientifiques qui analysent et cherchent à réduire cet impact », souligne Romain Michon. C’est ce qu’il appelle une approche « d’informatique musicale frugale ».

L’intelligence artificielle, omniprésente dans la recherche actuelle, est au cœur de la programmation. « L’IA est utilisée pour la composition musicale assistée et pour la synthèse sonore. Elle permet aujourd’hui de générer des sons de manière plus efficace et plus réaliste que les approches traditionnelles », explique-t-il. Ces innovations seront présentées au fil des conférences, notamment lors de la journée spéciale du 25 juin, organisée en lien avec le programme PEPR Icare, sur l’IA et le son immersif.

La LAC : une ouverture internationale et communautaire

Si les JIM s’inscrivent dans une dynamique francophone, la Linux Audio Conference (LAC) s’adresse à un public international. « La LAC est une conférence itinérante dédiée aux logiciels libres et open source pour l’audio. Elle rassemble entre 100 et 150 participants chaque année », précise Romain Michon.

Des conférences, démonstrations de logiciels libres, ateliers et concerts ponctueront les journées du 25 au 28 juin. L’un des points d’orgue ? La soirée du 28 au Sucre, à Lyon, avec une programmation de live coding conçue par le GRAME.

L’informatique musicale a toujours été portée par une communauté hybride : académique et passionnée. « La communauté du logiciel libre a toujours contribué de manière massive à ce domaine », rappelle le chercheur. La LAC valorisera des outils et technologies allant des synthétiseurs aux plateformes de MAO (musique assistée par ordinateur), en passant par des dispositifs sonores immersifs.

Un rendez-vous rare à l’INSA Lyon

Pourquoi avoir réuni ces deux conférences à l’INSA Lyon ? « C’était une évidence », affirme Romain Michon. « Notre équipe souhaitait organiser ces conférences et nous avons saisi l’occasion d’enchaîner les deux. C’est une opportunité unique pour nos étudiants. Trois d’entre eux auront d’ailleurs des publications acceptées aux JIM et à la LAC. »

La complémentarité des deux événements est évidente : « Certains participants feront les six jours. La LAC est dans la continuité des JIM, avec une dimension plus pratique et internationale. »

À tous les curieux, artistes, ingénieurs, étudiants et amateurs de musique, Romain Michon lance une invitation claire : « Les JIM et la LAC traitent de sujets passionnants : traitement du signal, IA, création sonore, interfaces musicales… C’est une opportunité rare, et gratuite, pour découvrir un champ de recherche et de création en pleine effervescence. »

GNOMON - Théâtre Astrée - Université Lyon 1

Lundi 23 juin 2025 - Deux séances 19:19 ou 20:20. Performance sous dôme ambisonique - Gratuit sur réservation

FOLIA - Théâtre Astrée - Université Lyon 1

Mardi 24 juin 2025 - Séance à 19:19. Concert pour contrebasse et électronique - Gratuit sur réservation

LAC PERFORMANCES - Théâtre Astrée - Université Lyon 1

Jeudi 26 et vendredi 27 juin 2025 - Séances à 19:19. Musique exploratoire et expérimentale - Gratuit sur réservation

Sciences & Société

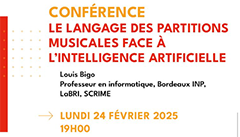

Le langage des partitions musicales face à l'intelligence artificielle

Conférencier : Louis Bigo, professeur en informatique, Bordeaux INP, LaBRI, SCRIME

Cet exposé présente une variété de travaux de recherche autour de représentations informatiques et d'algorithmes destinés à enrichir l'analyse et la composition musicale. La notion de langage musical sera approchée à travers des composants essentiels des partitions, incluant la structure, la texture ou encore les annotations relatives à la pratique instrumentale dans le cas spécifique des tablatures de guitare. Nous évoquerons également l’adaptation d’outils d’intelligence artificielle élaborés dans le domaine du Traitement Automatique du Langage Naturel (TALN) pour l’étude des partitions, ainsi que la tendance de ces outils à nous interroger sur l’assimilation de la musique à un type particulier de langage.

Conférence proposée dans le cadre du cycle de conférences organisé par le pôle de Mathématiques, la BMC et la Maison des Mathématiques et de l'Informatique.

Informations complémentaires

- https://bibliotheque.insa-lyon.fr/cms/articleview/id/7152

-

INSA Lyon - Bibliothèque Marie Curie - Amphithéâtre Émilie du Châtelet

Recherche

« La puissance de calcul numérique a modifié la façon de fabriquer la musique »

Quel est le point commun entre « l’instru » du dernier titre de Jul, la bande originale de Matrix et le générique du journal télévisé de 20h ? Ces mélodies emploient toutes des instruments de musique numériques. En effet, dans le monde de la musique, la vague de numérisation ne s’arrête pas seulement à la composition assistée par ordinateur : la lutherie a vu l’apparition d’instruments augmentés.

Au sein du laboratoire Citi1, l’équipe EMERAUDE2 s’applique à développer de nouveaux langages et des outils de programmation de traitement du signal pour les systèmes embarqués. Si ses membres ne sont pas tous musiciens, l’équipe entretient une relation particulière à la musique, par le biais d’un langage de programmation intitulé « FAUST » pour Functional AUdio STream. Inventé par Yann Orlarey, il y a une vingtaine d’années, ce langage permettant la synthèse et le traitement du son, a rendu le développement de la musique de synthèse plus accessible. Immersion dans le grand monde de l’informatique musicale avec Tanguy Risset, enseignant-chercheur et responsable de l’équipe EMERAUDE.

Qu’appelle-t-on « informatique musicale » ou « computer music » ?

L’informatique musicale, ou « musique programmable », est une discipline qui englobe la synthèse, la composition et le traitement sonore assistés par ordinateur. Elle requiert des langages de programmation et des compétences hautement techniques. Les professionnels de la « computer music » utilisent les mathématiques et des algorithmes pour produire différents sons, ambiances ou mélodies. Cette discipline a pris beaucoup de place dans notre vie quotidienne. Les premiers sons synthétisés demandaient des temps de calcul énormes sur les premiers ordinateurs. Depuis, grâce à la puissance de calcul et aux connaissances numériques, l’informatique musicale est capable d’imiter des sons d’instrument de façon très convaincante.

Aujourd’hui, il est facile d’accéder à un titre via des applications de streaming depuis son smartphone ou son ordinateur. Concrètement, comment sont traduites les informations lues numériquement avant d’arriver jusqu’aux oreillettes de nos écouteurs filaires ?

La musique que nous écoutons via nos smartphones ou nos ordinateurs transite entre l’analogique et le numérique et vice versa. Grâce à des « codecs » qui sont des traducteurs d’informations comme les cartes son par exemple, l’information est transformée, passant d’un état analogique à un état numérique et inversement. En fait, ce codec produit la tension électrique utilisée par les haut-parleurs. Avant les technologies numériques, on produisait analogiquement des formes d’ondes ; le numérique est seulement une autre technologie pour enregistrer la musique : les sons étaient reproduits de façon analogique, c’est-à-dire qu’à une vibration correspondait un signal électrique ou un champ magnétique que l’on représente par une courbe. Pour le numérique, les informations sont aussi représentées par une courbe similaire, à la différence que pour un ordinateur, cette courbe est constituée de points qui, liés entre eux, reproduisent la courbe. Chacun de ces points est codé avec des bits, seize par exemple pour les CD. Les langages de programmation, comme « FAUST », sont les outils nécessaires pour coder ces points.

En 2001, Yann Orlarey, membre de l’équipe EMERAUDE, créait le langage FAUST à l’Institut GRAME. Pouvez-vous nous décrire cet outil dont l’objectif est de rendre le traitement et la synthèse de sons plus accessibles ?

Il existe une pluralité de langages de programmation qui se succède depuis les années 1960. C’est la beauté du langage de programmation : derrière les boutons, il y a énormément d’informations. Cependant, avant les années 2000, les langages existants à l’époque étaient très verbeux et très difficiles d’accès pour les programmateurs en herbe. « FAUST » est né d’une volonté de faciliter l’usage des utilisateurs non-informaticiens, fournissant une alternative simple et de haut-niveau, offrant les mêmes niveaux de performance que les langages de programmation traditionnels. Ce langage s’est beaucoup développé depuis sa création, donnant des collaborations avec l’Université de Stanford, très impliquée en matière d’informatique musicale. Il a aussi servi de support à des projets de médiation, et d’autres applications artistiques et industrielles. Aujourd’hui, il est toujours disponible en open-source3.

Depuis 20 ans, le langage FAUST est utilisé par la communauté d’informatique musicale et sert aussi pour la recherche. Quelle est la suite de l’histoire ?

Effectivement, « FAUST » est utile à une communauté d’académiques, d’informaticiens ou de musiciens. En plus de vingt ans, l’écosystème s’est agrandi : désormais, il est possible de développer en « FAUST » sur tout type d’environnement. Un outil aussi modulaire nécessite forcément une maintenance rigoureuse. Du côté de la recherche et des applications industrielles, au sein de l’équipe EMERAUDE, plusieurs applications sont en cours, notamment sur des compilations sur FPGA4. FAUST ouvre de nouvelles possibilités pour des systèmes vibratoires, de l’acoustique embarquée ou développer de nouveaux outils musicaux pour des compositeurs ou même des amateurs éclairés.

Le Gramophone, dispositif de médiation conçu par l’Institut GRAME : une application

concrète de concepts scientifiques utilisant la création musicale et la programmation informatique. (Crédits : GRAME)

_________

[1] Centre d’Innovation en Télécommunications et Intégration de services (INSA Lyon/INRIA/Université de Lyon)

[2] EMERAUDE : Embedded Programmable Audio Systems

[3] Faustdoc.grame.fr

[4] FPGA est l'abréviation de « Field-programmable gate array », ce qui peut être traduit en français par « réseau de portes programmables sur site ».